浏览原职位详情

- 职位介绍

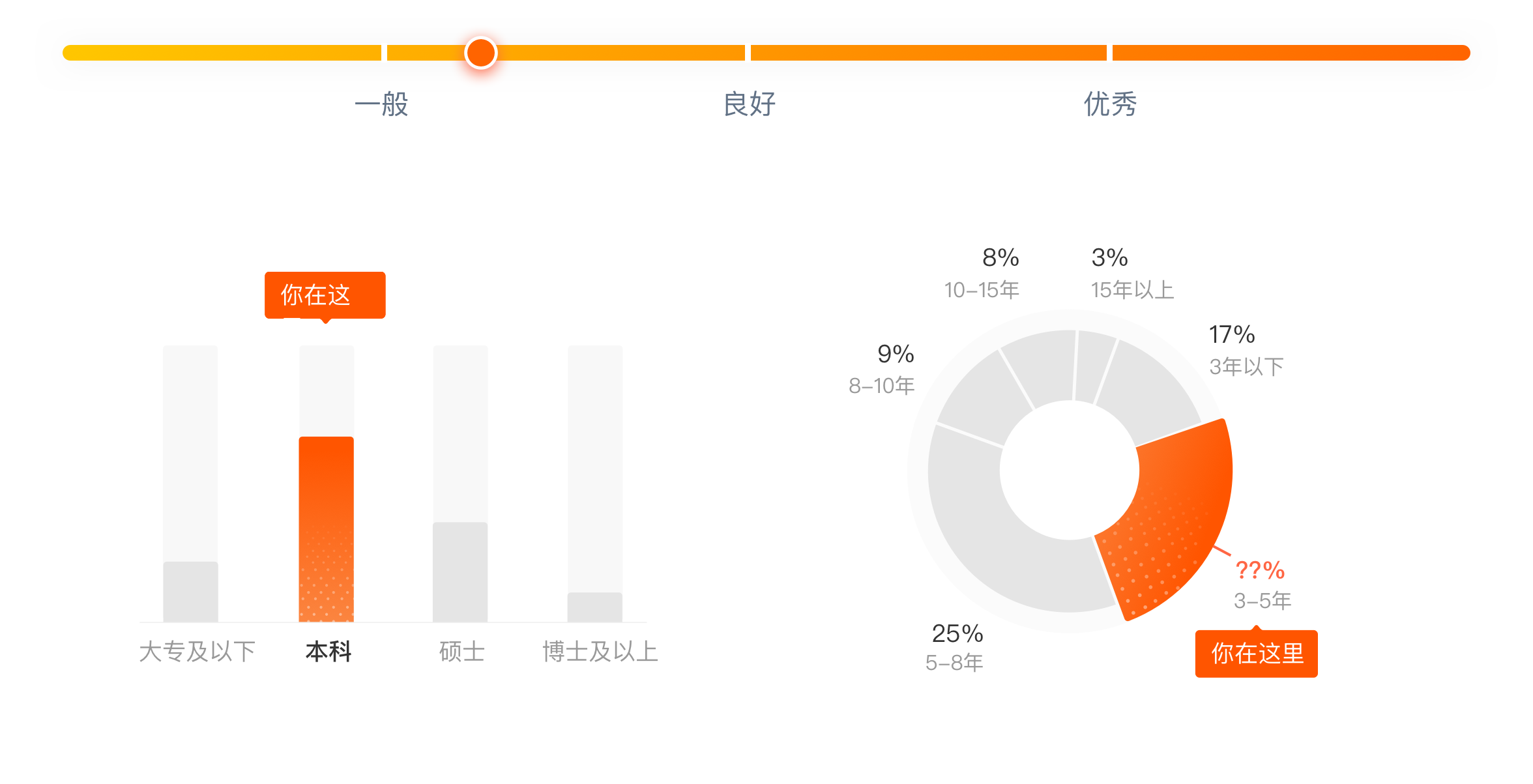

- 岗位职责: 1.负责Hadoop大数据平台架构分析、构建; 2.负责基于Hadoop生态系统的研发; 职位要求: 1.大学本科及以上学历,计算机相关专业; 2.三年以上工作经验; 3.熟悉Hadoop生态系统组件,如:Hadoop、Storm、Spark、Flume、Kafka、HBase、Hive、Pig、Zooer; 4.熟悉Linux开发环境; 5.熟悉ElasticSearch、Storm、Spark优先; 6.能够读懂及书写英文文档; 7.有Storm、Spark调优、统计学知识的优先考虑; 8.有机器学习经验者优先考虑。

猎聘温馨提示:

- 1. 如您发现平台内招聘方存在以下违规行为的,请立即举报

-

- a. 扣押您的身份证件或者其他证件;

- b. 要求您提供担保人、担保金或者以其他名义向您收取财物( 如培训费、体检费、资料费、置装费、押金等);

- c. 强迫您入股或者向您集资;

- d. 以招聘名义牟取不正当利益;

- e. 发布虚假招聘广告信息;

- f. 存在其他损害您的合法权益的行为。

- 2. 如您应聘的岗位属于涉外劳务合作/海外岗位的,请务必核实招聘方对外劳务合作资质取得情况,同时注意自身资金安全,防范招聘欺诈。

- 了解更多安全防范知识>

猜你喜欢

洪女士

招聘专员

肖女士

资深顾问(SC)

1